L’IA explicable: Décoder la boîte noire

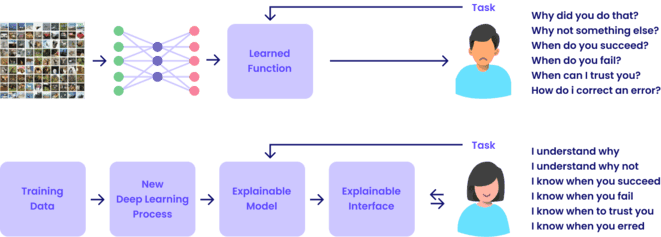

Imaginez un médecin qui recommande un traitement mais qui ne peut expliquer pourquoi. Vous lui ferez peut-être confiance, mais vous resterez sceptique. Maintenant, appliquez cette même situation à un modèle d'intelligence artificielle (IA) : comment pouvons-nous faire confiance à une IA si nous ne comprenons pas ses décisions ? C’est ici que l’IA explicable (« Explainable AI » ou XAI) entre en jeu.

Dans cet article, nous allons explorer pourquoi l’IA explicable est essentielle, les outils et méthodes pour rendre les modèles compréhensibles, et des cas pratiques illustrant son importance.

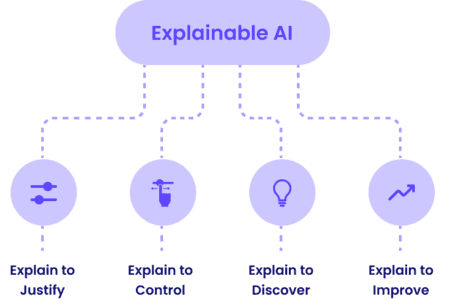

Pourquoi l’IA explicable est-elle importante ?

L’IA a le potentiel de révolutionner des domaines tels que la santé, la finance, et la justice. Cependant, beaucoup de modèles modernes, comme les réseaux de neurones profonds, sont souvent considérés comme des « boîtes noires » en raison de leur complexité. Voici pourquoi expliquer ces modèles est crucial :

- Confiance et adoption : Si les utilisateurs comprennent comment une IA arrive à une décision, ils sont plus enclins à lui faire confiance.

- Détection des biais : Une IA explicable permet d’identifier et de corriger les biais qui pourraient affecter les décisions.

- Conformité réglementaire : Dans certains secteurs, comme la finance, les régulations exigent que les décisions algorithmiques soient justifiées.

- Amélioration des modèles : Comprendre pourquoi un modèle se trompe aide les développeurs à l’améliorer.

Outils et méthodes pour l’IA explicable

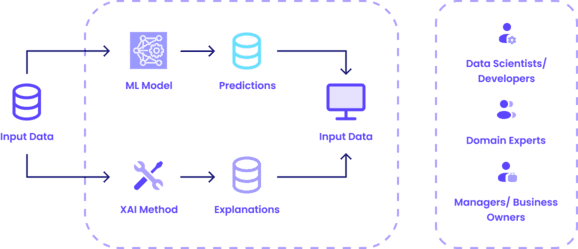

Les approches de l’IA explicable visent à fournir des modèles de machine learning plus transparents et interprétables. Voici les principales catégories :

1. Importance des features (Feature Importance)

Cette approche identifie et classe les caractéristiques “features” en fonction de leur contribution à la prédiction du modèle. Elle aide à déterminer les facteurs les plus influents dans les résultats du modèle.

2. Attribution des prédictions (Attribution)

L’attribution mesure la contribution de chaque feature à une prédiction spécifique. Les méthodes comme SHAP (SHapley Additive exPlanations) et LIME (Local Interpretable Model-agnostic Explanations) permettent d’attribuer les résultats aux caractéristiques d’entrée :

- SHAP : Utilise la valeur de Shapley de la théorie des jeux pour fournir des explications globales et locales.

- Exemple : SHAP peut montrer que le « revenu » d’un client contribue à 30 % à la décision d’octroi d’un crédit.

- LIME : Cette méthode explique le fonctionnement d’un modèle complexe en créant un modèle linéaire simple, mais uniquement autour de la prédiction à interpréter. Autrement dit, LIME analyse localement le comportement du modèle pour chaque prédiction spécifique.

- Exemple : LIME peut indiquer quelles zones d’une image ont influencé une classification.

3. Visualisation (Visualization)

Les techniques de visualisation permettent de représenter graphiquement la structure, les paramètres et les prédictions du modèle. Elles incluent :

- Grad-CAM : Pour les réseaux neuronaux convolutifs, Grad-CAM montre quelles zones d’une image influencent le plus le modèle.

- Exemple : En vision par ordinateur, Grad-CAM peut indiquer les parties d’une radiographie qui ont guidé la détection d’une anomalie.

- Diagrammes d’arbre : Pour les arbres de décision et les forêts aléatoires, ils montrent comment les features sont utilisées dans les décisions.

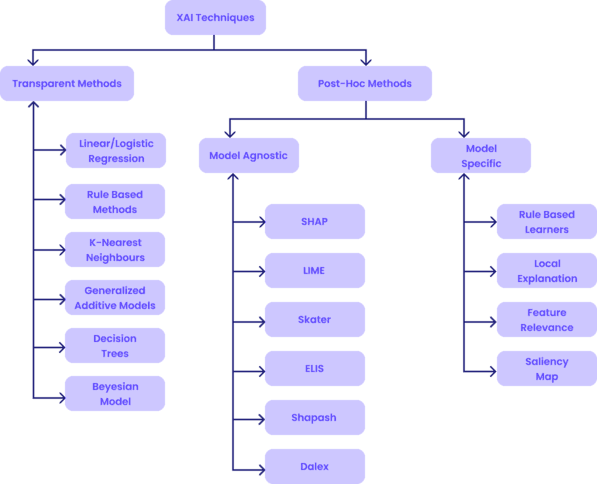

4. Exploration des approches via l’arbre des techniques XAI

L’arbre des techniques XAI ci-dessous offre une vision claire des différentes approches disponibles pour rendre les modèles explicables. Ces approches se divisent en deux grandes catégories :

- Méthodes transparentes : Ces techniques utilisent des modèles simples et interprétables par nature, comme les régressions linéaires/logistiques, les arbres de décision, et les modèles bayésiens. Ces méthodes n’ont pas besoin d’outils supplémentaires pour expliquer leurs prédictions.

- Méthodes post-hoc : Ces techniques expliquent des modèles complexes après leur entraînement. Elles incluent :

- Approches agnostiques au modèle : Utilisables sur tout type de modèle, avec des outils comme SHAP, LIME, ELI5, et Dalex.

- Approches spécifiques au modèle : Adaptées à certains types de modèles, comme les réseaux neuronaux, en utilisant des visualisations comme les Saliency Maps.

Exploration des outils Python à travers un exemple

Voici un exemple pratique basé sur l’utilisation de SHAP pour expliquer un modèle de prédiction des prix immobiliers.

Supposons que le modèle utilise les données suivantes :

- % classe ouvrière : Proportion de la population ouvrière dans une zone donnée.

- Nombre de pièces : Nombre moyen de pièces par logement.

- Concentration de NOX : Niveau de pollution atmosphérique par les oxydes d’azote.

- Distance des centres d’emploi : Mesure de l’éloignement par rapport aux opportunités d’emploi.

- Taux de criminalité : Taux de criminalité par habitant.

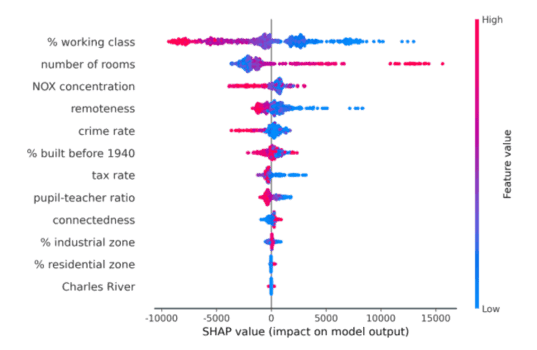

Après entraînement du modèle, voici une visualisation SHAP des résultats :

D'après le graph, on peut extraire les informations suivantes:

- Importance des caractéristiques : Les caractéristiques en haut du graphique, comme le « % working class» et le «number of rooms», ont le plus grand impact sur les prédictions.

- Valeurs des SHAP :

- Les valeurs positives (à droite de 0) augmentent le prix immobilier prédictif.

- Les valeurs négatives (à gauche de 0) diminuent le prix immobilier prédictif.

- Couleurs :

- Rouge : Valeurs élevées des caractéristiques (par exemple, un grand nombre de pièces).

- Bleu : Valeurs faibles des caractéristiques (par exemple, un faible taux de criminalité).

Avec ces informations :

- Les urbanistes peuvent cibler la réduction de la pollution (concentration de NOX) et du taux de criminalité pour améliorer les valeurs immobilières.

- Les agents immobiliers peuvent mettre en avant des caractéristiques positives comme le nombre de pièces pour justifier les prix élevés.

Cette analyse permet également d’identifier si le modèle reflète des relations logiques entre les variables ou si des ajustements sont nécessaires.

Limites et défis de l’IA explicable

Bien que l’IA explicable soit essentielle, elle présente aussi des limites :

- Complexité : Les outils comme SHAP ou LIME peuvent eux-mêmes devenir complexes à interpréter pour les non-initiés.

- Temps de calcul : Les méthodes d’interprétation peuvent être gourmandes en ressources.

- Précision : Simplifier un modèle complexe pour l’expliquer peut résulter en une perte d’exactitude dans les explications.

Conclusion:

L’IA explicable est une étape essentielle pour faire le lien entre la puissance des modèles complexes et leur adoption réelle dans des domaines critiques. En rendant les modèles transparents, nous favorisons une meilleure collaboration entre l’humain et la machine.

Que ce soit à l’aide de SHAP, LIME, ou Grad-CAM, l’IA explicable permet non seulement de comprendre les modèles, mais aussi de les améliorer, de renforcer la confiance et de développer des systèmes plus éthiques.

À l’heure où les décisions algorithmiques influencent de plus en plus nos vies, investir dans l’explicabilité, c’est garantir une IA responsable, utile et alignée sur les besoins humains.

Références

https://www.sciencedirect.com/science/article/pii/S1566253523001148

https://www.edps.europa.eu/system/files/2023-11/23-11-16_techdispatch_xai_en.pdf

https://www.ibm.com/think/topics/explainable-ai

https://www.iosb.fraunhofer.de/en/competences/image-exploitation/human-ai-interaction/explainable-ai.html

https://www.geeksforgeeks.org/explainable-artificial-intelligencexai/

https://www.aidancooper.co.uk/a-non-technical-guide-to-interpreting-shap-analyses/