Qualité des données : fondamentaux et stratégies gagnantes

Qualité des données : fondamentaux et stratégies gagnantes

Que se passe-t-il quand vos algorithmes d'IA les plus sophistiqués sont alimentés par des données de mauvaise qualité ? La réponse est simple : GIGO - Garbage In, Garbage Out. À l'heure où l'intelligence artificielle promet de révolutionner le monde des affaires, une réalité s'impose : la puissance d'une IA se mesure à la qualité des données qui l'alimentent.

Dans cet article, nous examinerons d'abord ce qui définit aujourd'hui l'excellence des données dans un environnement numérique en mutation, avant d'évaluer l'impact concret des données défaillantes sur les organisations. Nous explorerons ensuite les dimensions essentielles qui caractérisent des données fiables, identifierons les points de fragilité dans la chaîne de données, pour enfin proposer une approche méthodique d'amélioration adaptée aux enjeux actuels du cloud et de l'IA.

Qualité des données : le nouveau standard de l'excellence digitale

La qualité des données est devenue un pilier stratégique dans l'écosystème numérique moderne, dépassant largement le simple cadre de la gestion de données traditionnelle. À l'ère du cloud computing et de l'intelligence artificielle, elle englobe non seulement les caractéristiques intrinsèques des données, mais également l'ensemble des processus et gouvernance nécessaires pour garantir leur excellence.

Dans le contexte actuel, des données sont considérées comme qualitatives lorsqu'elles peuvent être exploitées de manière fiable à travers l'ensemble de la chaîne de valeur : des opérations quotidiennes aux analyses prédictives, en passant par les algorithmes d'IA et les outils d'aide à la décision. Cette exigence de qualité devient particulièrement critique dans les environnements cloud où les données circulent entre différentes plateformes et applications.

La qualité des données reflète ainsi la maturité d'une organisation dans sa capacité à mettre en place une gouvernance robuste, notamment via des solutions de Master Data Management (MDM), garantissant que les données restent fiables et cohérentes à travers tous les systèmes d'information, qu'ils soient sur site ou dans le cloud.

Son importance se manifeste à plusieurs niveaux stratégiques :

- Performance des modèles d'IA : Des données de qualité sont le prérequis indispensable pour développer des modèles d'IA performants et dignes de confiance. La qualité des prédictions et des insights générés dépend directement de la fiabilité des données d'entraînement.

- Prise de décision augmentée : Dans un monde où les décisions sont de plus en plus guidées par la data, la précision et la fiabilité des données permettent aux entreprises d'exploiter pleinement le potentiel des outils analytiques avancés pour anticiper les tendances et saisir les opportunités du marché.

- Sécurité et conformité : À l'heure où les architectures cloud multiplient les points d'accès aux données, la qualité des données joue un rôle crucial dans la détection des anomalies, la gestion des risques et le respect des réglementations en matière de protection des données.

- Innovation technologique : Des données de qualité constituent le socle sur lequel reposent les initiatives d'innovation, qu'il s'agisse de développer de nouveaux services basés sur l'IA, d'automatiser des processus ou d'exploiter les technologies émergentes comme l'IA générative pour enrichir les bases de connaissances internes (systèmes de RAG), ou pour développer des LLMs spécialisés.

Cette qualité influence également l'efficacité des catalogues data modernes et des plateformes de gouvernance data, essentiels pour maintenir une vision unifiée et fiable du patrimoine data de l'entreprise dans un environnement technologique de plus en plus complexe.

Données de mauvaise qualité : l'impact dévastateur sur votre compétitivité à l'ère de l'IA

L'impact de données de mauvaise qualité sur une entreprise est aujourd'hui plus critique que jamais, amplifié par la transformation digitale et l'adoption massive de l'IA. Les conséquences se manifestent à plusieurs niveaux :

- Dégradation de la performance des modèles d'IA :

- Modèles prédictifs peu fiables générant des insights erronés

- Systèmes RAG (Retrieval-Augmented Generation) produisant des réponses inexactes

- Chatbots d'entreprise donnant des informations incorrectes aux clients

- Augmentation des risques d'hallucinations des LLMs sur des données non fiables

- Décisions stratégiques compromises :

- Analyses prédictives faussées menant à des investissements mal orientés

- Biais dans les algorithmes de machine learning impactant les décisions automatisées

- Tableaux de bord et KPIs erronés conduisant à des stratégies inadaptées

- Opportunités d'innovation manquées par manque de données fiables

- Impact financier majeur :

- Selon les dernières études de Gartner (2023), le coût moyen de la mauvaise qualité des données est estimé à 15 millions de dollars par an et par organisation

- Surcoûts liés au nettoyage et à la préparation des données pour les projets d'IA

- Ressources supplémentaires nécessaires pour la validation et la correction des données

- Perte de revenus due à des opportunités commerciales manquées

- Risques réglementaires et de conformité accrus :

- Non-conformité aux réglementations sur la protection des données (RGPD, CCPA)

- Risques liés à l'utilisation de données non fiables dans les systèmes d'IA

- Exposition potentielle en cas de décisions automatisées basées sur des données erronées

- Sanctions financières et juridiques plus sévères dans le contexte actuel

- Dégradation de l'expérience client :

- Personnalisation défaillante due à des données client incorrectes

- Recommandations produits inappropriées par les systèmes d'IA

- Interactions frustrantes avec les chatbots mal entraînés

- Perte de confiance dans les services numériques de l'entreprise

- Inefficacité opérationnelle dans le cloud :

- Synchronisation défectueuse entre les systèmes cloud et on-premise

- Duplications et incohérences dans les environnements multi-cloud

- Problèmes d'intégration avec les services cloud tiers

- Coûts de stockage et de traitement accrus pour des données non pertinentes

- Frein à l'innovation technologique :

- Impossibilité de développer des cas d'usage IA avancés

- Retard dans l'adoption des technologies émergentes

- Perte d'avantage concurrentiel dans la course à l'innovation

Les piliers d'une donnée fiable : 3 dimensions critiques à maîtriser

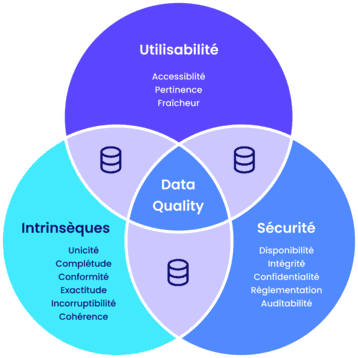

À l'heure où la donnée devient l'actif stratégique des entreprises, l'évaluation de sa qualité repose sur trois dimensions fondamentales: la dimension d'utilisabilité, la dimension intrinsèque et la dimension de sécurité. Chacune de ces dimensions est composée de plusieurs critères spécifiques que les données doivent respecter pour être considérées comme de bonne qualité.

La dimension d'utilisabilité détermine la facilité d'exploitation des données dans un contexte métier :

- Accessibilité :

- Disponibilité pour tous les cas d'usage (analyses, reporting, IA, etc.)

- Interfaces standardisées et documentation claire

- Performance d'accès adaptée aux besoins opérationnels

- Interopérabilité entre les différents systèmes

- Pertinence contextuelle :

- Alignement avec les objectifs métiers

- Granularité adaptée aux différents niveaux d'analyse

- Capacité à supporter la prise de décision

- Valorisation dans les processus opérationnels

- Fraîcheur :

- Actualisation alignée sur les cycles métier

- Historisation intelligente des données

- Gestion des versions et des mises à jour

- Synchronisation entre les systèmes

La dimension intrinsèque garantit la fiabilité inhérente des données :

- Unicité :

- Identification unique des entités

- Gestion des doublons cross-systèmes

- Référentiels de données maîtrisés

- Réconciliation des données multi-sources

- Complétude :

- Exhaustivité des attributs critiques

- Identification des données manquantes

- Enrichissement contextuel

- Standards de qualité par domaine métier

- Conformité :

- Respect des formats et standards métier

- Alignement avec les normes sectorielles

- Compatibilité réglementaire (RGPD, etc.)

- Validation des règles métier

- Exactitude :

- Précision adaptée aux usages

- Validation métier automatisée

- Détection des anomalies

- Processus de correction structuré

- Incorruptibilité :

- Protection contre les altérations

- Validation des modifications

- Conservation de l'intégrité

- Traçabilité des changements

- Cohérence :

- Harmonisation cross-fonctionnelle

- Standardisation des référentiels

- Cohérence temporelle

- Alignement sémantique

La dimension de sécurité assure la protection et la confiance :

- Confidentialité :

- Contrôles d'accès contextuels

- Chiffrement adapté aux usages

- Protection des données sensibles

- Gestion fine des habilitations

- Intégrité :

- Garantie de non-altération

- Mécanismes de validation

- Contrôles de cohérence

- Pistes d'audit fiables

- Disponibilité :

- Continuité de service garantie

- Performance stable

- Résilience des systèmes

- Plans de reprise opérationnels

- Authenticité :

- Validation des sources

- Certification des données

- Traçabilité de l'origine

- Garantie de provenance

- Auditabilité :

- Traçabilité complète

- Historique des modifications

- Reporting de conformité

- Supervision des accès

Diagnostic data : identifier les maillons faibles de votre chaîne de données

Les problèmes de qualité des données proviennent de sources multiples, dont la complexité s'accroît avec la transformation numérique des organisations. Voici une analyse approfondie des principales sources de détérioration :

1. Facteur Humain et Processus

- Erreurs de saisie et d'interaction :

- Erreurs manuelles lors de la saisie

- Interprétations subjectives des données

- Non-respect des procédures de validation

- Formations insuffisantes des utilisateurs

- Défaillances organisationnelles :

- Silos organisationnels

- Responsabilités mal définies

- Communication inefficace entre équipes

- Processus de validation non formalisés

2. Architecture et Intégration

- Fragmentation des systèmes :

- Multiplicité des sources de données

- Architectures legacy non optimisées

- Intégrations complexes entre systèmes

- Synchronisation imparfaite des données

- Problèmes d'interopérabilité :

- Formats de données incompatibles

- Différences de nomenclature

- Modèles de données inconsistants

- Interfaces mal documentées

3. Cycle de Vie des Données

- Obsolescence :

- Données non actualisées

- Historisation mal gérée

- Cycles de rafraîchissement inadaptés

- Purge inefficace des données périmées

- Problèmes de migration :

- Pertes lors des transferts

- Mappings incorrects

- Incompatibilités de formats

- Tests de migration insuffisants

4. Standards et Référentiels

- Manque de standardisation :

- Absence de référentiels communs

- Standards métier non respectés

- Formats hétérogènes

- Règles de gestion non harmonisées

- Qualité des sources externes :

- Données tierces non validées

- Standards différents entre partenaires

- Intégration de sources multiples

- Contrôles d'import insuffisants

5. Infrastructure et Technique

- Défaillances techniques :

- Problèmes d'infrastructure

- Bugs applicatifs

- Erreurs de configuration

- Performances dégradées

- Problèmes de stockage :

- Capacités insuffisantes

- Fragmentation des données

- Backup/restore défaillants

- Archivage mal géré

6. Gouvernance et S�écurité

- Faiblesses de gouvernance :

- Politiques data insuffisantes

- Rôles et responsabilités flous

- Processus qualité incomplets

- Supervision inadéquate

- Vulnérabilités sécuritaires :

- Contrôles d'accès insuffisants

- Protection des données inadaptée

- Traçabilité limitée

- Gestion des incidents défaillante

7. Méthodologie et Exploitation

- Lacunes méthodologiques :

- Absence de métriques qualité

- Procédures non documentées

- Tests insuffisants

- Monitoring inadapté

- Problèmes d'exploitation :

- Maintenance préventive limitée

- Gestion des changements déficiente

- Résolution d'incidents tardive

- Documentation technique obsolèt

La compréhension de ces sources de problèmes permet aux organisations de :

- Mettre en place des contrôles préventifs

- Développer des stratégies d'amélioration ciblées

- Prioriser les actions correctives

- Optimiser les investissements qualité

Votre feuille de route vers l'excellence des données

L'amélioration de la qualité des données nécessite une approche structurée et holistique, alignée sur les enjeux contemporains de la data. Voici le guide des pratiques essentielles, organisé en piliers stratégiques :

1. Diagnostic et Évaluation Continue

- Profilage avancé des données :

- Analyse automatisée des structures et patterns

- Cartographie des flux de données

- Détection préventive des anomalies

- Scoring qualité par domaine de données

- Monitoring temps réel :

- Tableaux de bord dynamiques

- Alertes préventives

- KPIs de qualité personnalisés

- Supervision cross-systèmes

2. Standardisation et Harmonisation

- Gouvernance des référentiels :

- Mise en place de data models standardisés

- Gestion des référentiels métier (MDM)

- Normalisation des formats et nomenclatures

- Alignement sémantique

- Homogénéisation multi-source :

- Règles de transformation unifiées

- Standards de qualité par domaine

- Protocoles d'échange normalisés

- Reconciliation automatisée

3. Optimisation et Nettoyage

- Nettoyage intelligent des données :

- Correction automatisée des anomalies

- Validation contextuelle

- Enrichissement sémantique

- Normalisation adaptative

- Dédoublonnage avancé :

- Algorithmes de matching sophistiqués

- Gestion des doublons cross-systèmes

- Règles de fusion paramétrables

- Traçabilité des déduplication

4. Enrichissement et Valorisation

- Stratégies d'enrichissement :

- Intégration sources externes qualifiées

- Enrichissement contextuel

- Croisement données internes/externes

- Validation des données enrichies

- Valorisation métier :

- Alignement use cases business

- Enrichissement sémantique

- Contextualisation des données

- Scoring valeur métier

5. Contrôle et Certification

- Frameworks de contrôle :

- Règles de validation métier

- Contrôles multi-niveaux

- Certification des données critiques

- Validation automatisée

- Assurance qualité :

- Tests automatisés

- Validation métier structurée

- Processus de certification

- Audit trail complet

6. Outillage et Automatisation

- Solutions technologiques :

- Outils de data quality spécialisés

- Automatisation des contrôles

- Plateformes de data governance

- Solutions de MDM

- Intégration des technologies avancées :

- Data quality by design

- Automatisation intelligente

- Workflows qualité

- Pipeline de données robustes

7. Organisation et Culture

- Développement des compétences :

- Formation continue des équipes

- Certification des data stewards

- Sensibilisation aux enjeux qualité

- Partage des bonnes pratiques

- Culture data quality :

- Responsabilisation des acteurs

- Communication transverse

- Incentives qualité

- Collaboration cross-fonctionnelle

8. Mesure et Amélioration Continue

- Métriques et reporting :

- Indicateurs de performance qualité

- Reporting automatisé

- Analyse des tendances

- ROI des initiatives qualité

- Optimisation continue :

- Revue périodique des processus

- Ajustement des contrôles

- Benchmark pratiques

- Innovation méthodologique

Cette approche structurée permet de :

- Établir une base solide pour la qualité des données

- Automatiser les processus qualité

- Responsabiliser les acteurs

- Mesurer et améliorer en continu

- Créer une culture de l'excellence des données

Conclusion

La qualité des données s'impose aujourd'hui comme un impératif stratégique dans un monde où l'IA et le cloud redéfinissent les standards d'exploitation des données. Au-delà d'un simple enjeu technique, elle constitue le socle sur lequel reposent l'innovation et la compétitivité des organisations.

Cette excellence requiert une approche globale combinant gouvernance robuste, processus industrialisés, culture data partagée et technologies adaptées. L'investissement dans la qualité des données n'est plus une option, mais une nécessité stratégique qui permet non seulement d'éviter les coûts cachés, mais aussi de transformer les données en véritables catalyseurs de valeur.

Les organisations qui réussiront demain seront celles qui auront su faire de la qualité des données non pas un projet ponctuel, mais une discipline continue, intégrée dans leur ADN opérationnel et stratégique.